Google Gemini: Flex/Priority Inference удешевил ИИ до 35%

Google's Gemini API introduces Flex & Priority Inference tiers, cutting AI costs up to 35% by optimizing latency and efficiency.

Google Gemini: Flex/Priority Inference удешевили ИИ на 35%

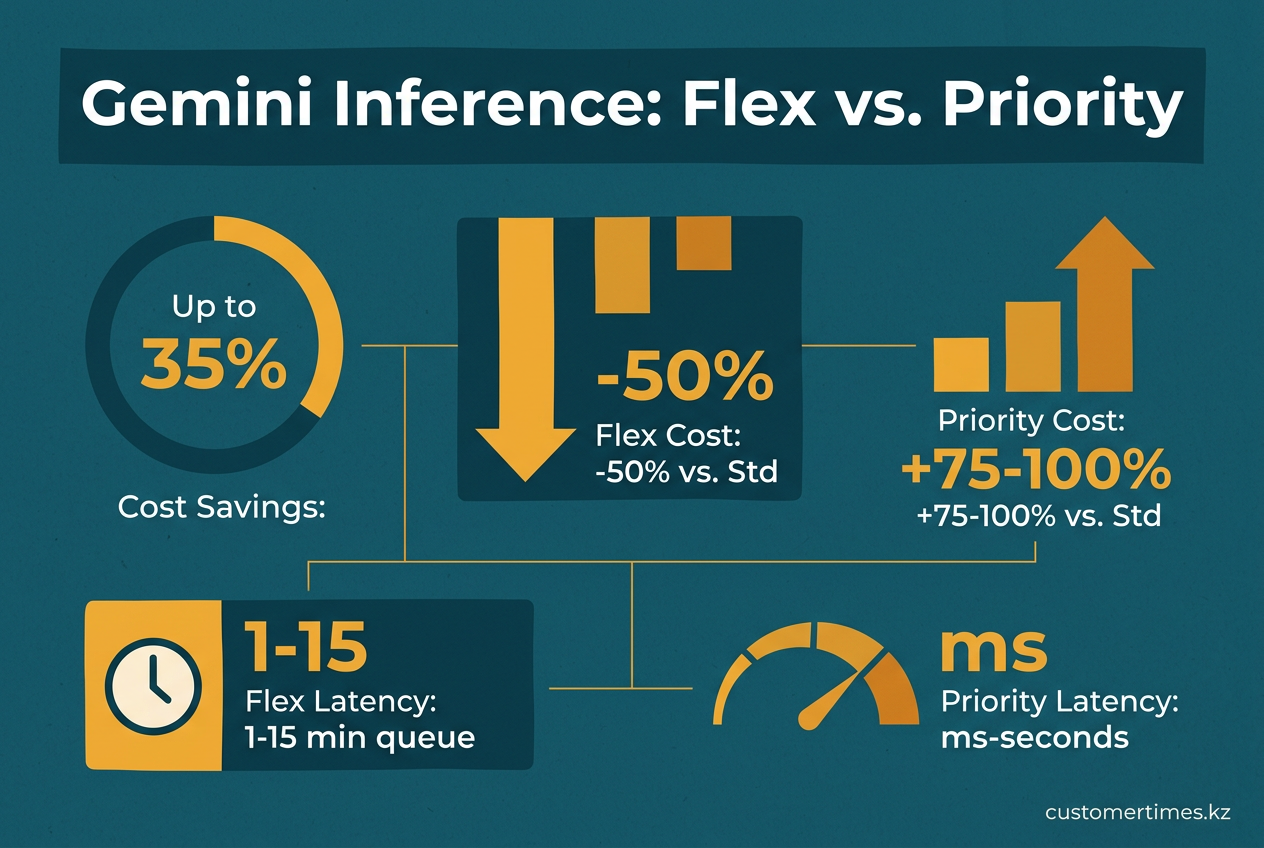

Новые уровни сервиса Flex Inference и Priority Inference для Google Gemini снижают стоимость использования ИИ до 35%. Этот подход заменяет единую цену гибкой моделью: теперь компании могут выбирать между экономным пакетным режимом (Flex) и премиальным real-time сервисом (Priority) для каждого API-вызова с помощью параметра service_tier. Ранние последователи сообщают о значительном сокращении расходов на ИИ без ущерба для стандартов задержки (SLO) в пользовательских приложениях.

Что такое Flex Inference и Priority Inference в Google Gemini API?

Flex Inference и Priority Inference - это два уровня обслуживания в Gemini API. Flex предназначен для несрочных, фоновых задач и обрабатывает их в очереди по сниженной цене. Priority, напротив, гарантирует мгновенные ответы с низкой задержкой для критически важных приложений, но стоит дороже.

| Уровень | Цена vs. Стандартный | Типичная задержка | Прерываемый? | Правило переполнения |

|---|---|---|---|---|

| Flex | - 50% | очередь 1-15 мин | Да, внепиковая мощность | Нет (по возможности) |

| Priority | +75-100% | мс-секунды | Нет, высший приоритет | Автопереход на Standard при превышении квоты |

Внедрение для разработчиков реализовано бесшовно. Запросы отправляются на те же синхронные эндпоинты (GenerateContent, Interactions), а API возвращает заголовок с указанием использованного уровня. Это позволяет FinOps-системам точно отслеживать и атрибутировать затраты на конкретные бизнес-процессы, будь то обновление CRM или работа чат-бота.

Почему уровневый inference появился в 2026 году

Появление уровневого инференса стало ответом на стремительный рост спроса на ИИ-вычисления, который, по прогнозам, превысит 90 ГВт и к 2030 году обгонит затраты на обучение моделей. Гиперскейлеры не успевают строить дата-центры, поэтому фокус сместился с наращивания числа GPU на оптимизацию их использования. Устаревшее оборудование теперь обслуживает очереди Flex с высокой задержкой, а новейшие кластеры зарезервированы для Priority-трафика. Этот подход создает эффективную двойную инфраструктуру из одного парка оборудования, максимизируя рентабельность инвестиций в чипы.

«Мы не можем бесконечно наращивать вычисления, поэтому индустрия должна наращивать эффективность».

- Каутар Эль Маграуи, IBM Research, брифинг о трендах 2026

Паттерны внедрения в компаниях уже работают

-

Динамические балансировщики нагрузки

Крупный международный дистрибьютор направляет все запросы через внутренний маршрутизатор. Запросы из POS-систем получают уровень Priority, а ночная пакетная обработка данных о лояльности клиентов отправляется в очередь Flex. Управление происходит через изменение заголовка, что устраняет необходимость в отдельной кодовой базе для пакетных задач. -

Агентские workflow

Сложные агентские рабочие процессы (workflows), объединяющие несколько вызовов модели для исследования или суммирования, идеально подходят для Flex. По умолчанию внутренние «мыслительные» шаги агента выполняются на уровне Flex со скидкой 50%, а для генерации финального ответа пользователю уровень повышается до Priority. -

Перелив на edge

Ритейлеры, использующие модели Gemini на периферийных устройствах (edge), применяют умный паттерн резервного переключения. Изначально запросы обрабатываются в локальном микро-ЦОДе с уровнем Priority. Во время пиковых нагрузок, например в «Чёрную пятницу», при исчерпании локальной квоты запросы бесшовно перенаправляются на стандартный облачный уровень, что предотвращает отказы в обслуживании.

Цены, которые меняются со временем

Google не вводит отдельные SKU: скидки и наценки применяются автоматически при выставлении счёта. Скидка 50% для Flex обеспечивается за счёт утилизации простаивающих мощностей (аналогично спотовым VM), а синхронный характер API избавляет от необходимости переписывать код под асинхронную модель. Наценка 75 - 100% за Priority гарантирует качество обслуживания (QoS) и включает политику «плавного понижения»: избыточный трафик переводится на уровень Standard, а не блокируется.

Конкурентное преимущество, пока что

На данный момент Google обладает явным конкурентным преимуществом. Конкуренты, такие как OpenAI и Anthropic, предлагают преимущественно фиксированную цену за токен, а «Provisioned Throughput» от AWS Bedrock - это резервирование мощностей, а не сервис-уровень, основанный на задержке. Это делает Gemini API первым решением с настоящими уровнями обслуживания, позиционируя его как самый экономичный вариант для задач, нечувствительных к задержкам. При этом не требуется переход на асинхронную архитектуру. Аналитики ожидают, что конкуренты вскоре представят аналогичные модели.

Компании с ежемесячными счетами за вычисления ИИ в «десятки миллионов» теперь рассматривают Flex как внутренний углеродный кредит: каждые 1 млн токенов Flex экономят ~0.4 кВт·ч, что в масштабах портфелей на миллионы пользователей складывается в целые мегаватты.

Практические шаги для внедрения

- Анализ трафика: Перед внедрением маркируйте API-вызовы метаданными (например,

user-facingvsinternal) в течение одного биллингового цикла. Это поможет выявить запросы, которые являются кандидатами для Priority и Flex. - Централизованная обёртка: Создайте лёгкую внутреннюю библиотеку, которая будет добавлять заголовок

service_tier. Это централизует логику выбора уровня и позволит избежать изменений в коде сторонних SDK. - Мониторинг понижений: Настройте логирование для отслеживания случаев, когда запросы Priority автоматически понижаются до Standard. Частые понижения указывают на необходимость скорректировать квоту, а не изменять код.

- Учёт вариативности задержки: Среднее время ожидания в очереди Flex составляет менее 3 минут, но 95-й перцентиль задержки может достигать 15 минут. Убедитесь, что ваши фоновые задачи способны выдержать такой разброс во времени выполнения.

- Интеграция с кэшированием: Для повторяющихся запросов используйте кэширование в сочетании с Flex inference. Это позволит обслуживать часть запросов мгновенно из кэша, а для новых запросов - экономить за счёт использования отложенной обработки.

Уровневый инференс делает Gemini API универсальным инструментом: он одновременно служит экономичным движком для фоновых процессов и премиальным сервисом для real-time-взаимодействий. Практика показывает, что перевод всего 40% внутреннего трафика на Flex высвобождает бюджет, достаточный для удвоения количества Priority-вызовов. Такая модель позволяет одновременно повышать качество обслуживания и сокращать затраты на ИИ, что является мощным преимуществом для любого бизнеса.